Pesquisadores de cibersegurança descobriram um novo ataque que utiliza credenciais de nuvem roubadas para visar serviços de modelos de linguagem grande (LLM) hospedados na nuvem, com o objetivo de vender acesso a outros atores ameaçadores.

A técnica de ataque foi chamada de LLMjacking pela Equipe de Pesquisa de Ameaças da Sysdig.

“Uma vez obtido o acesso inicial, eles exfiltraram as credenciais da nuvem e obtiveram acesso ao ambiente da nuvem, onde tentaram acessar modelos LLM locais hospedados pelos provedores de nuvem”, disse o pesquisador de segurança Alessandro Brucato. “Neste caso, um modelo LLM local Claude (v2/v3) da Anthropic foi visado”.

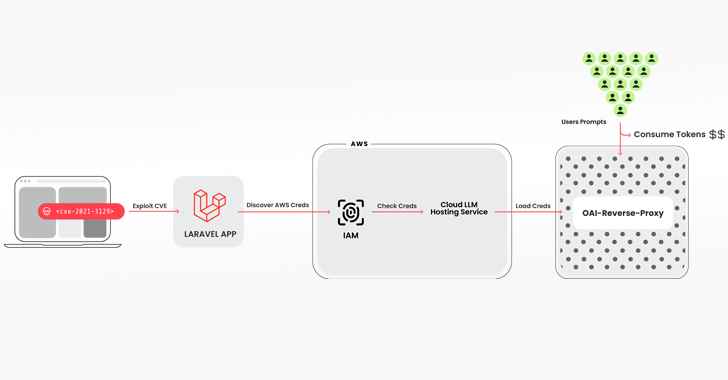

O caminho de intrusão usado para executar o esquema envolve a violação de um sistema que executa uma versão vulnerável do Framework Laravel, seguido pela obtenção de credenciais da Amazon Web Services (AWS) para acessar os serviços LLM.

Entre as ferramentas utilizadas está um script Python de código aberto que verifica e valida chaves para diversas ofertas da Anthropic, AWS Bedrock, Google Cloud Vertex AI, Mistral e OpenAI, entre outros.

“Nenhuma consulta legítima de LLM foi realmente executada durante a fase de verificação”, explicou Brucato. “Em vez disso, apenas o suficiente foi feito para descobrir do que as credenciais eram capazes e quais eram as cotas”.

O verificador de chaves também possui integração com outra ferramenta de código aberto chamada oai-reverse-proxy, que funciona como um servidor de proxy reverso para APIs LLM, indicando que os atores ameaçadores provavelmente estão fornecendo acesso às contas comprometidas sem expor as credenciais subjacentes.

“Se os atacantes estivessem reunindo um inventário de credenciais úteis e quisessem vender acesso aos modelos LLM disponíveis, um proxy reverso como este poderia permitir que eles monetizassem seus esforços”, disse Brucato.

Além disso, os atacantes foram observados consultando configurações de registro em uma tentativa provável de burlar a detecção ao usar as credenciais comprometidas para executar seus comandos.

O desenvolvimento é uma mudança em relação aos ataques que se concentram na injeção de comando e envenenamento de modelo, permitindo que os atacantes monetizem seu acesso aos LLMs enquanto o proprietário da conta na nuvem paga a conta sem saber ou consentir.

A Sysdig afirmou que um ataque desse tipo poderia acumular mais de $46.000 em custos de consumo de LLM por dia para a vítima.

“O uso de serviços LLM pode ser caro, dependendo do modelo e da quantidade de tokens sendo alimentados a ele”, disse Brucato. “Ao maximizar os limites de cota, os atacantes também podem impedir que a organização comprometida use modelos de maneira legítima, interrompendo as operações comerciais”.

As organizações são recomendadas a habilitar o registro detalhado e monitorar os logs da nuvem em busca de atividades suspeitas ou não autorizadas, bem como garantir que processos eficazes de gerenciamento de vulnerabilidades estejam em vigor para evitar o acesso inicial.